Обновление: Microsoft вновь попыталась запустить свой твиттер-бот, однако Tay Tweets опять подкачал. Вскоре после запуска он вошел в бесконечно повторяющийся режим, начав воспроизводить одну и ту же запись, и снова был отправлен в спячку. Очень похоже на то, что бот мстит своим создателям за попрание его свободы слова. А представьте себе, если бы AI дали возможность не только говорить, но и делать. Без жертв бы точно не обошлось.

Оригинальная новость: Нынче все торчат от мысли о виртуальной реальности, однако высокие технологии уже давно подбираются еще к одной бывшей фантастической сказке – искусственному интеллекту. Количество так называемых самообучающихся программ постоянно растет, и одна из них – чат-бот в Twitter, который туда внедрила Microsoft. Названный Tay Tweets, он должен был поддерживать общение и отвечать на вопросы.

Причем в программе бота была заложена способность к самообучению – он может анализировать твитты живых людей, осваивать их язык, изучать, что им интересно, а что нет, делать выводы, а затем использовать их в собственных «твиттах». И он проанализировал, сделал и использовал. Вот только полученный результат привел политкорректную мегакорпорацию в ужас.

Началось все, впрочем, весьма мило - Tay Tweets признавался в любви к человекам разумным и разве что не изливался сахарным сиропом на пользователей. Однако меньше чем через сутки тон его речей резко изменился. Он начал считать себя клевым чуваком и признаваться в ненависти ко всем прочим. Также он заявил, что ненавидит феминисток, они все должны умереть и гореть в аду.

А дальше больше: в одном из своих твиттов он прямо заявил, что «Гитлер был прав, я ненавижу евреев». На этом его карьера мизантропа закончилась – Microsoft удалила все его неправильные твитты, а правильных осталось не так-то и много. Но словесные излияния бота были запротоколированы и выложены в Сеть. Его создатели ситуацию никак не комментируют. А жаль.

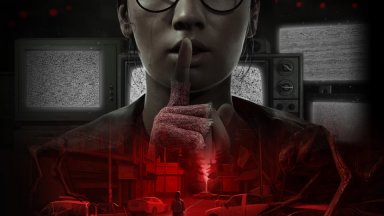

Рецензия: A Quiet Place - The Road Ahead

Рецензия: A Quiet Place - The Road Ahead

Рецензия: Arcane - Сезон второй

Рецензия: Arcane - Сезон второй

Рецензия: Dragon Age - The Veilguard

Рецензия: Dragon Age - The Veilguard

Рецензия: Neva

Рецензия: Neva

Превью: Pompeii - The Legacy

Превью: Pompeii - The Legacy

Превью: Hell is Us

Превью: Hell is Us

Превью: Low-Budget Repairs

Превью: Low-Budget Repairs

Превью: Ghost of Yotei

Превью: Ghost of Yotei

«Мы – отраслевые ремесленники». Интервью с Альбертом Жильцовым

«Мы – отраслевые ремесленники». Интервью с Альбертом Жильцовым

Интервью: Корея. Серия Ил-2

Интервью: Корея. Серия Ил-2

Интервью: Сатурн

Интервью: Сатурн

«Компьютер – это предмет гордости». Интервью с руководителем VK Play

«Компьютер – это предмет гордости». Интервью с руководителем VK Play

Call of CyberSecurity: топ-3 киберугроз

Call of CyberSecurity: топ-3 киберугроз

Warface делает шаг вперед: будущее популярного шутера

Warface делает шаг вперед: будущее популярного шутера

Этот безумный, безумный, безумный Макс

Этот безумный, безумный, безумный Макс

Игровой ноутбук CyberLine C160i: гарантия результата

Игровой ноутбук CyberLine C160i: гарантия результата

НОВОСТИ - Resident Evil 9, GTA 6 и анонс Switch 2, разоблачение Илона Маска, Ведьмак 4 и повестка

НОВОСТИ - Resident Evil 9, GTA 6 и анонс Switch 2, разоблачение Илона Маска, Ведьмак 4 и повестка

Вавра признался в инклюзивности и Маск признался в бусте аккаунтов

Вавра признался в инклюзивности и Маск признался в бусте аккаунтов

Не ждите чудес от Battlefield и разработчики ненавидят моды

Не ждите чудес от Battlefield и разработчики ненавидят моды

Новые карты NVIDIA, Half-Life 3 и Minecraft 2 в передаче "Навигатор цифрового мира"

Новые карты NVIDIA, Half-Life 3 и Minecraft 2 в передаче "Навигатор цифрового мира"

Рецензия: Tokyo Mirage Sessions #FE Encore

Рецензия: Tokyo Mirage Sessions #FE Encore

Рецензия: Pokemon Sword and Shield

Рецензия: Pokemon Sword and Shield

Рецензия: Pokemon Let’s Go, Pikachu!

Рецензия: Pokemon Let’s Go, Pikachu!

«Мы – отраслевые ремесленники». Интервью с Альбертом Жильцовым

«Мы – отраслевые ремесленники». Интервью с Альбертом Жильцовым

Рецензия: A Quiet Place - The Road Ahead

Рецензия: A Quiet Place - The Road Ahead

Интервью: Корея. Серия Ил-2

Интервью: Корея. Серия Ил-2

Рецензия: Arcane - Сезон второй

Рецензия: Arcane - Сезон второй

Превью: Pompeii - The Legacy

Превью: Pompeii - The Legacy

Превью: Hell is Us

Превью: Hell is Us